こんにちは、ティールです!

「FLUX.1 が重くて動かせない」と悩んでいませんか?

そのような方は、GGUF のモデルがオススメです!

GGUF モデルは、容量が軽量化されているので、

パソコンのスペックが低くても動かすことができるんです!

この記事は、このような方に向けて書いてます。

GGUF とは?

GGUF(GPT-Generated Unified Format)とは、

AIモデルを効率よく保存したり読みこんだりするためのファイル形式のことです。

量子化されているので、

モデルの容量が小さくなり、動作が速くなります!

FLUX.1 は、ハイスペックなパソコンが必要ですが、

GGUF のモデルを使うことで、動かせるようになりますよ!

GGUF のメリットとデメリット

GGUF のメリット

- 容量が小さくなる

- 読み込みが速い

- 動作が軽い

GGUF のデメリット

- 画像生成の結果が少し変わる

- 画像生成の品質が少し落ちる

- 一部の機能や調整が使えなくなる

FLUX.1-GGUF のモデルのダウンロード

今回は「Q8.gguf」をダウンロードしていきます。

「Q8」のモデルは「FP16」と比べて、

品質の劣化がほとんどなく、容量が少し小さくなっているので高く評価されています。

Unet をダウンロードする

Unet を、以下の URL からダウンロードしてください。

Unet をダウンロードする

FLUX.1 Dev GGUF

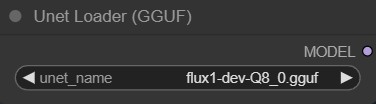

- flux1-dev-Q8_0.gguf

FLUX.1 Schnell GGUF

- flux1-schnell-Q8_0.gguf

2. Unet をフォルダに配置する

Unet を以下のフォルダに配置します。

「ComfyUI/models/unet」

VAE をダウンロードする

1. VAE をダウンロードする

VAE を、以下の URL からダウンロードしてください。

- ae.safetensors

2. VAE をフォルダに配置する

VAE を以下のフォルダに配置してください。

「ComfyUI/models/vae」

CLIP をダウンロードする

1. CLIP をダウンロードする

CLIP を、以下の URL からダウンロードしてください。

- t5-v1_1-xxl-encoder-Q8_0.gguf

- clip_l.safetensors

2. CLIP をフォルダに配置する

CLIP を、以下のフォルダに配置してください。

「ComfyUI/models/clip」

ComfyUI-GGUF のノードのインストール

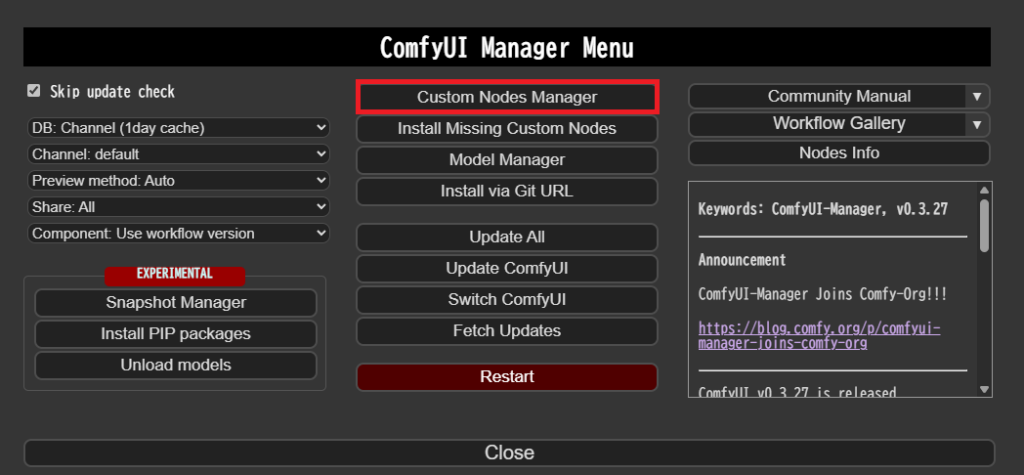

まずは、「ComfyUI-Manager」から「Custom Nodes Manager」を開いてください。

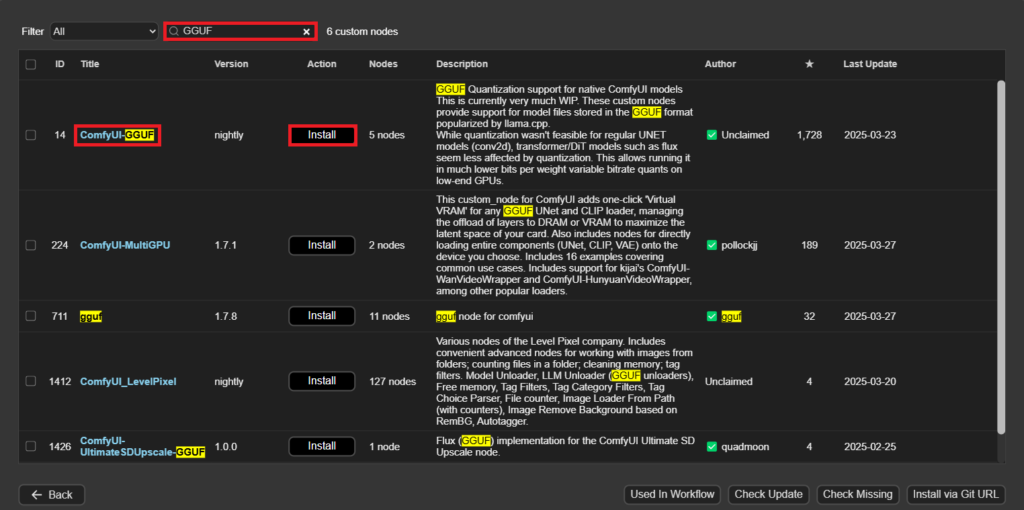

そして、検索欄に「GGUF」と入力して検索します。

「ComfyUI-GGUF」をインストールしてください

FLUX.1-GGUF のワークフロー

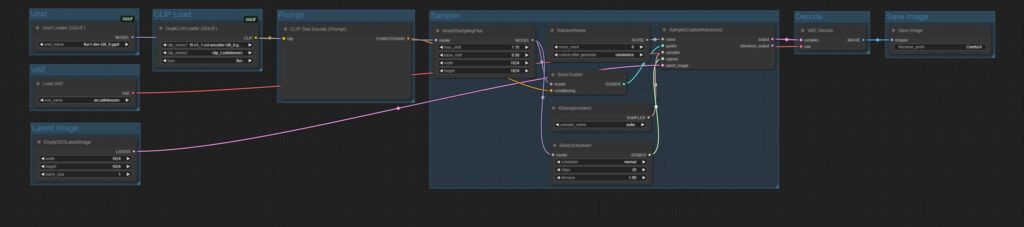

以下のワークフローは、

僕が個人的に作ったワークフローになります。

以下のファイルから、ワークフローをダウンロードできます。

JSONファイルを ComfyUI の画面にドラッグ&ドロップすると、ワークフローが読み込めます。

FLUX.1-GGUF のノード

ワークフローを読み込んだら、ノードを設定します。

ダウンロードしたモデルをノードにセットしてください。

Unet のノード

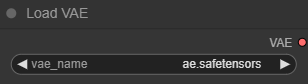

VAE のノード

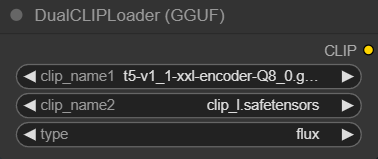

CLIP のノード

まとめ

いかがだったでしょうか。

この記事では、FLUX.1 の GGUF についてご紹介しました。

GGUF のモデルは、

高品質な画像生成を可能にしつつ、

量子化によってモデルサイズを削減し、

必要なVRAMを抑えることができます。

GGUF形式での提供によって、

大きいモデルをローカルのパソコンでも使えるようになりました!

今後の生成AIは、こうした「軽くて賢いモデル」が中心になっていくと思われます。

この記事が、あなたのお役に立てればとても嬉しいです。

最後まで読んでいただき、ありがとうございました。

コメント